Punti chiave

I Google Core Updates ricalcolano l’autorevolezza dell’intero ecosistema web attraverso algoritmi avanzati di intelligenza artificiale che valutano la qualità globale dei siti indicizzati. Queste modifiche strutturali premiano l’esperienza diretta degli autori sugli argomenti trattati e l’aderenza all’intento di ricerca degli utenti, cercando di identificare e neutralizzare le manipolazioni. La visibilità organica nei risultati dipende dunque dalla coerenza semantica dei contenuti e dal reale valore che offrono ai navigatori.

-

Valutazione olistica del dominio

Gli algoritmi di aggiornamento di Google superano l’analisi della singola pagina per misurare l’autorevolezza complessiva dell’architettura web, integrando filtri anti-spam e modelli di recupero vettoriale come MUVERA;

-

Neutralizzazione delle manipolazioni

I sistemi di update isolano e annullano retroattivamente il valore dei backlink (link in entrata) artificiali e dei contenuti di bassa qualità, rendendo possibile un eventuale recupero del ranking non prima del successivo Core Update;

-

Impatto sui settori sensibili

Le pagine web che riguardano salute, finanza e commercio elettronico possono subire notevoli fluttuazioni nel ranking, che favoriscono le realtà istituzionali e penalizzano gli aggregatori privi di recensioni verificate;

-

Neutralità verso la generazione artificiale

I criteri di classificazione non discriminano i testi prodotti tramite intelligenza artificiale, ma svalutano però drasticamente i contenuti privi di supervisione editoriale umana e utilità effettiva;

-

Filtri in Google Discover

Il feed di notizie per dispositivi mobili Google Discover applica filtri geografici rigorosi e premia la competenza tematica verticale, svalutando istantaneamente i titoli sensazionalistici e le pubblicazioni occasionali fuori nicchia.

Introduzione e definizione dei Google Core Updates

I Google Core Updates rappresentano le modifiche strutturali più significative applicate al motore di ricerca di Alphabet Inc. Questi aggiornamenti alterano le fondamenta stesse del sistema di classificazione dei risultati. Il loro scopo principale consiste nel premiare i contenuti di altissima qualità e migliorare l’esperienza di ricerca degli utenti.

Cos’è un Google Core Update: natura e obiettivi primari

Il Google Core Update interviene sul nucleo centrale dell’algoritmo di ricerca (il sistema matematico che ordina le pagine web). Google modifica i criteri di valutazione per allineare i risultati alle aspettative degli utenti. Questo processo ricalcola l’importanza di miliardi di pagine web indicizzate.

L’obiettivo primario di queste operazioni consiste nell’aumentare la visibilità dei materiali autorevoli e pertinenti, poiché allineati agli intenti di ricerca degli utenti. Il sistema esegue una rivalutazione generale e simultanea dell’intero ecosistema web. I nuovi criteri di qualità vengono applicati a tutti i domini presenti nell’indice di ricerca.

Evoluzione storica: dagli aggiornamenti mirati agli interventi strutturali

Nei primi anni di vita del motore di ricerca, le modifiche algoritmiche colpivano tecniche di manipolazione specifiche. Gli ingegneri di Google rilasciavano filtri indipendenti per contrastare singole criticità. Questa strategia frammentata causava fluttuazioni continue e improvvise delle classifiche.

L’evoluzione tecnologica ha spinto l’azienda a modificare questa architettura di base. L’integrazione del machine learning (l’apprendimento automatico delle macchine) ha permesso di analizzare i siti web nella loro interezza. Le valutazioni separate sono state sostituite da un unico apparato di classificazione integrato.

Le macchine esaminano la qualità complessiva del dominio attraverso reti neurali complesse. I Core Updates rappresentano il culmine di questo passaggio verso una comprensione profonda del testo. Il sistema premia l’autorevolezza generale e l’esperienza dimostrata dall’autore.

Frequenza e dinamiche di rilascio (Rollout)

Google implementa gli aggiornamenti principali con una cadenza periodica. La frequenza media prevede diverse modifiche strutturali distribuite a distanza di mesi l’una dall’altra. L’azienda annuncia pubblicamente l’avvio di queste operazioni tramite i propri canali ufficiali.

La fase di distribuzione dell’aggiornamento viene definita tecnicamente Rollout (il periodo di rilascio effettivo). Questo processo richiede solitamente dalle due alle quattro settimane per completare la propagazione globale. I centri dati sparsi sul pianeta necessitano di questo tempo fisico per ricalcolare i posizionamenti.

Durante questa finestra temporale, i risultati di ricerca subiscono alterazioni profonde e repentine. I professionisti del settore osservano cambiamenti sostanziali nel traffico organico, cioè quello generato dai visitatori provenienti dai risultati gratuiti e che può essere oggetto di ottimizzazione con pratiche di Search Engine Optimization (SEO). La stabilizzazione delle classifiche di posionamento nelle pagine dei risultati del motore (SERP) avviene in modo definitivo solo al termine ufficiale delle procedure di calcolo.

Come funzionano gli aggiornamenti principali

Gli interventi al motore di ricerca operano attraverso un sistema di filtri matematici integrati che non operano in modo ‘isolato’ su singole pagine web. I sistemi di intelligenza artificiale attuano infatti un allineamento continuo per valutare la qualità complessiva dell’interezza dei siti.

Il Modello della valutazione globale del sito

Il calcolo della pertinenza, come si diceva, supera dunque l’esame del singolo articolo per estendersi al dominio nella sua totalità. Il motore di ricerca esamina la coerenza dei materiali pubblicati da un editore nel tempo. Questa analisi previene il posizionamento di contenuti singoli ben scritti all’interno però di piattaforme generalmente scadenti.

I filtri misurano l’esperienza dell’autore e la profondità delle informazioni fornite. Un aggiornamento principale modifica il modo in cui il sistema percepisce l’autorità generale di un intero progetto web. Le pagine perdono o guadagnano visibilità in base al punteggio di qualità assegnato all’architettura principale.

L’Integrazione dei sistemi algoritmici (Helpful Content, Reviews, Spam)

L’architettura del motore di ricerca fonde molteplici moduli di controllo in un unico processo di classificazione. Il sistema valuta simultaneamente la chiarezza dell’esposizione, la presenza di recensioni autentiche e l’assenza di manipolazioni. I rilasci periodici degli aggiornamenti calibrano i filtri per disincentivare la pubblicazione di testi che abbiano scarsa originalità.

L’identificazione e la gestione dei contenuti scadenti si affida a reti neurali come SpamBrain (il modulo di intelligenza artificiale per la prevenzione dello spam). L’inserimento di nuovi parametri permette al sistema di riconoscere reti di domini scaduti e architetture di link manipolative. I controlli non abbattono l’intero sito web in modo punitivo, ma eseguono una neutralizzazione selettiva della parte compromessa.

Questa logica chirurgica isola e ignora proattivamente i collegamenti artificiali e le pagine generate per manipolare i risultati. La rimozione di questa spinta meccanica provoca un riposizionamento verso il basso, poiché i benefici dei link spam vengono sottratti in modo definitivo.

L’infrastruttura di recupero vettoriale (MUVERA e Graph Foundation Model)

Il motore di ricerca deve analizzare miliardi di pagine web per restituire i risultati giusti in poche frazioni di secondo. L’azienda sviluppa sistemi matematici sempre più efficienti per alleggerire questo enorme carico di lavoro e velocizzare le risposte agli utenti. Il nucleo centrale dell’algoritmo integra a questo scopo il sistema MUVERA e il Graph Foundation Model.

La tecnologia MUVERA aumenta la precisione nell’estrazione delle pagine e riduce le risorse dei server necessarie. Il modello GFM espande la capacità del sistema di comprendere i concetti attraverso strutture a grafo complesse. La combinazione di queste due architetture abbassa i tempi di latenza (il ritardo nella risposta) per gli utenti.

Il motore di ricerca valuta le relazioni semantiche nascoste tra i concetti con un’accuratezza nettamente superiore. Questa ottimizzazione strutturale supporta le operazioni per le frasi lunghe e le ricerche articolate. I server gestiscono le analisi richieste dai grandi modelli linguistici in modo estremamente rapido.

Il Ruolo dei Search Quality Rater e le Linee guida (E-E-A-T)

L’istruzione delle intelligenze artificiali dipende da migliaia di valutatori umani chiamati Search Quality Rater. Questi operatori seguono un manuale ufficiale per giudicare l’affidabilità e l’esperienza dimostrata su una pagina in cui viene definito il framework di principi E-E-A-T (Experience, Expertise, Authoritativeness, Trust). Le regole di valutazione subiscono modifiche costanti per riflettere le nuove esigenze di sicurezza.

I manuali aggiornati introducono restrizioni severe per le tematiche che incidono sulla società e sulle istituzioni, denominate YMYL (Your Money or Your Life). I rater devono applicare la massima cautela verso le informazioni pubbliche, le votazioni e le crisi geopolitiche. Le direttive equiparano inoltre i giudizi qualitativi per le risposte generate dall’intelligenza artificiale a quelli previsti per i risultati classici.

Il parametro dell’affidabilità diventa il fattore centrale e vincolante per classificare gli argomenti sensibili. L’utilizzo di espressioni linguistiche tipiche delle macchine automatiche segnala agli operatori una mancanza di revisione editoriale umana. Questa disattenzione comporta una classificazione negativa nei punteggi di competenza stabiliti dalle linee guida centrali.

Impatto sulle SERP e analisi della volatilità

I Google Core Updates, come illustrato in precedenza generano spesso variazioni significative nella disposizione dei risultati di ricerca. L’osservazione di questi movimenti permette ai professionisti di comprendere le nuove logiche di classificazione. Le variazioni repentine definiscono le priorità strutturali del motore di ricerca.

Identificare l’impatto: cali algoritmici vs. fluttuazioni fisiologiche

Distinguere un calo dovuto a un aggiornamento da una normale variazione di traffico richiede un’analisi attenta. Le fluttuazioni fisiologiche avvengono quotidianamente per aggiustamenti minori o per normali cambiamenti nella domanda degli utenti. Le piattaforme specialistiche di misurazione esterne al motore (come Semrush Sensor) documentano le fluttuazioni e la volatilità dei risultati, che diventano di forte intensità in concomitanza con gli Updates.

Un calo algoritmico si manifesta con una perdita netta e improvvisa di posizioni per un volume elevato di parole chiave. Questa diminuzione si verifica in modo simultaneo su decine di pagine dello stesso sito web. Il traffico organico crolla repentinamente creando una linea di demarcazione evidente nei grafici di analisi.

Tempistiche di impatto: anomalie durante e dopo il rollout

Gli effetti di un aggiornamento principale non sono quasi mai istantanei. I data center globali richiedono un’elaborazione estesa per ricalcolare miliardi di nodi di connessione e aggiornare gli indici. Questa enorme mole di dati rende necessaria una propagazione graduale per evitare instabilità nei sistemi.

Durante il periodo di rilascio si verificano inversioni di tendenza e anomalie temporanee nei risultati mostrati agli utenti. Le classifiche subiscono oscillazioni continue prima di stabilizzarsi nella nuova configurazione. La valutazione definitiva dell’impatto su un sito web deve avvenire esclusivamente al termine ufficiale del processo di aggiornamento.

Differenze settoriali: eCommerce, YMYL e autorevolezza del marchio

Gli aggiornamenti possono colpire specifici settori con intensità e dinamiche differenti. Il motore di ricerca integra i segnali legati al marchio e le metriche di affidabilità in modo sempre più forte.

Le ripercussioni strutturali ridefiniscono le gerarchie di visibilità in base a categorie di mercato:

-

Commercio Elettronico e Abbigliamento

I domini con una solida infrastruttura per le vendite ottengono un netto incremento di visibilità. Il sistema favorisce generalmente i marchi istituzionali rispetto ai siti basati su recensioni amatoriali, valorizzando la stabilità e la forte autorevolezza transazionale;

-

Finanza e Istituzioni (YMYL)

Il settore finanziario registra crescite costanti in particolare per le piattaforme governative e i domini istituzionali. Queste entità beneficiano di un ricalcolo al rialzo dei pesi di autorevolezza grazie alla loro elevata densità di segnali fiduciari verificabili;

-

Salute e Medicina (YMYL)

I grandi portali enciclopedici possono subire contrazioni severe del traffico organico. L’algoritmo tende a prediligere le piattaforme che offrono dati strutturati e recensioni verificate sui professionisti sanitari, riducendo l’esposizione dei contenuti privi di utilità applicativa immediata;

-

Sistemi di Recensione e Aggregazione

Il motore di ricerca traccia una linea di demarcazione netta tra i siti basati su acquisti verificati e gli aggregatori aperti. Le piattaforme prive di rigidi controlli cedono quote di traffico a causa della loro intrinseca vulnerabilità allo spam generato dagli utenti, ma allo stesso tempo questa tipologia di contenuti può essere premiata quando genuina e verificabile.

Strategie di analisi e recupero post Core Update

Le procedure per ripristinare la visibilità organica richiedono un’analisi strutturale del progetto web. Le fluttuazioni indotte dagli aggiornamenti principali non dipendono quasi mai da singoli errori tecnici isolati. Il recupero necessita di una revisione completa incentrata sul valore reale offerto ai visitatori, che si attua attraverso specifici SEO audit .

L’Approccio alle Manipolazioni e ai Link Artificiali

Google ha modificato nel tempo l’approccio verso le pratiche manipolative, fino ad arrivare ad attuare una logica di neutralizzazione chirurgica per gestire le anomalie. Questo sistema sostituisce le precedenti azioni punitive rivolte indiscriminatamente all’intero dominio.

Le reti neurali isolano proattivamente i collegamenti artificiali e le sezioni create in serie per manipolare i risultati. Il sistema annulla il passaggio di valore associato a questi elementi non naturali. I siti web subiscono un riposizionamento verso il basso a causa della perdita retroattiva e definitiva dei benefici di ranking.

La pulizia formale del profilo dei collegamenti esterni non garantisce il recupero delle posizioni perse. In questi casi l’autorità artificiale sottratta non può essere riacquistata tramite semplici operazioni di correzione tecnica.

Audit dei contenuti: metriche di qualità, rilevanza e utilità

La valutazione dei materiali pubblicati richiede un’indagine severa sul grado di approfondimento che apportano. I sistemi di classificazione devono misurare l’utilità effettiva senza discriminare a priori tra testi generati dall’intelligenza artificiale o da esseri umani. Il processo di classificazione deve però premiare unicamente le risorse capaci di soddisfare appieno le esigenze di ricerca, non quelle più rapide o più economiche da realizzare.

La produzione massiva di contenuti basati su modelli preimpostati provoca come già ricordato perdite di visibilità drastiche. La supervisione editoriale rigorosa rimane un requisito indispensabile per certificare la competenza pratica.

Tempistiche di recupero: Il ciclo tra gli aggiornamenti

Visti i tempi tecnici necessari perché le ottimizzazioni possano essere assimilate dagli algoritmi di [b]Google[/b] occorre essere pazienti e monitorare costantemente la fase post-modifica, oltre che implementare costantemente la qualità dei contenuti e dei segnali esterni.

Un ripristino sostanziale del traffico organico si verifica solitamente in concomitanza con un successivo aggiornamento principale. Il sistema esegue un ricalcolo globale per accertare che i miglioramenti apportati risultino stabili. I professionisti devono quindi mantenere un piano di pubblicazione coerente e duraturo per ricostruire la fiducia del motore di ricerca.

Automazione della diagnostica: nuovi strumenti AI in Search Console

Gli strumenti di analisi delle prestazioni messi a disposizione da Google si avvale di interfacce sempre più autonome. Un segnale di questo cambiamento è stato la chiusura dello storico account istituzionale Search Liaison di Danny Sullivan, che da anni faceva da ‘ponte’ tra Google e i webmaster.

Il motore di ricerca punta sulla disponibilità di nuovi strumenti integrati per i responsabili dei siti web, come per esempio un filtro che consente di monitorare le prestazioni di gruppi di query, oppure un filtro avanzato per l’esclusione o l’inclusione automatica delle query legate ai marchi, che separa le ricerche per nome dell’azienda da quelle generali, in modo dai quantificare l’impatto reale dei contenuti al di là della notorietà del dominio.

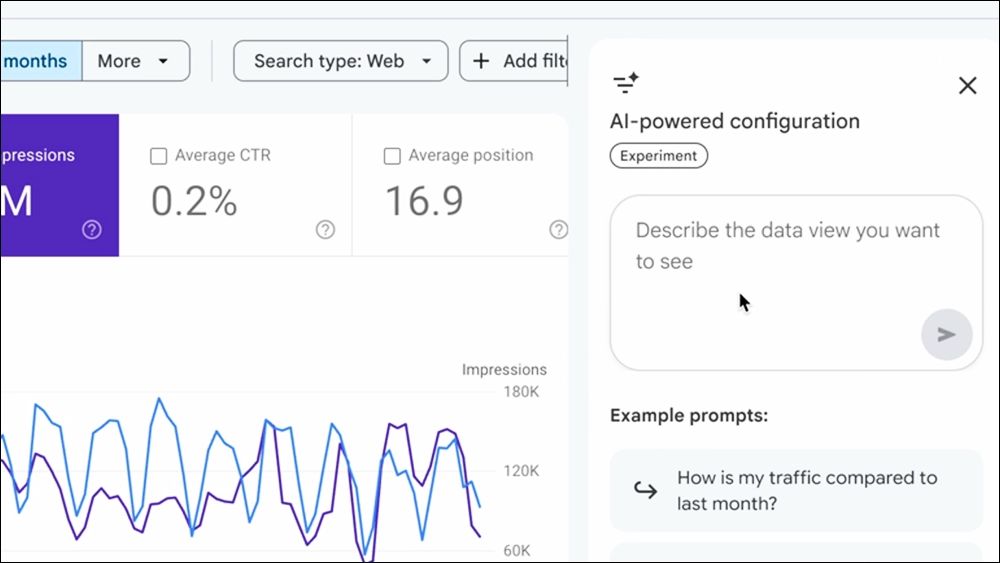

Le capacità analitiche sono state inoltre aumentate introducendo un modulo sperimentale di configurazione basata sull’intelligenza artificiale. Con questa funzionalità è possibile interrogare il database utilizzando espressioni in linguaggio naturale.

L’algoritmo traduce le richieste in filtri matematici e restituisce immediatamente i risultati sullo schermo, offrendo anche dei suggerimenti di ricerca come “Qual è il mio traffico rispetto al mese scorso?” oppure “Qual è stato il CTR delle mie pagine in Italia la settimana scorsa?”.

Ad oggi però non è ancora presente uno strumento specifico che separi il traffico proveniente dalle citazioni nei risultati generativi di Google Overviews o AI Mode, che rimane aggregato al traffico organico ‘classico’.

L’Evoluzione dei Core Updates con l’intelligenza artificiale e la ricerca semantica

L’integrazione dell’intelligenza artificiale generativa ha trasformato i criteri di classificazione dei risultati. Il motore di ricerca si concentra sull’estrazione del significato profondo dei testi. Le macchine valutano l’utilità reale delle informazioni rispetto alla semplice correttezza grammaticale.

L’Adattamento dei criteri di qualità ai contenuti generati dall’IA

Il sistema di classificazione risulta indifferente allo strumento utilizzato per la produzione del testo. Gli algoritmi non discriminano tra i materiali elaborati dalle reti neurali e quelli scritti da autori in carne ed ossa. L’analisi si concentra sul livello di utilità e sull’originalità erogata al lettore.

I manuali per i valutatori umani riflettono queste nuove dinamiche e penalizzano esplicitamente i documenti che presentano formule meccaniche che segnalano una inequivocabile generazione automatica di contenuti in assenza di controllo editoriale umano. Questa mancanza riduce drasticamente i punteggi legati all’esperienza empirica e alla competenza specifica sull’argomento.

Comprensione Vettoriale Profonda e Valutazione dell’Intento di Ricerca

Le tecnologie di elaborazione del linguaggio naturale permettono al motore di ricerca di andare oltre la semplice corrispondenza delle singole parole chiave. Il sistema esamina la struttura delle frasi per intercettare l’intento di ricerca latente (il vero bisogno informativo nascosto dietro la domanda). I processori matematici trasformano i testi in vettori per calcolare la distanza semantica tra i vari concetti.

Le infrastrutture avanzate mappano le informazioni creando enormi strutture a grafo per stabilire le relazioni tra entità diverse. L’aggiornamento dei sistemi di base ottimizza le operazioni di calcolo per le richieste più articolate. Le risorse web devono rispondere in modo esaustivo a queste reti concettuali complesse per ottenere un buon posizionamento.

Le nuove architetture IA alimentano la generazione di riassunti testuali in tempo reale posizionati nella parte superiore dello schermo. Le direttive impongono agli operatori di giudicare queste sintesi automatiche con la medesima severità applicata ai frammenti in primo piano classici. L’accuratezza fattuale rappresenta il requisito inderogabile per l’intera composizione della pagina dei risultati.

Dinamiche Algoritmiche in Google Discover

Il feed di notizie automatico Google Discover opera attraverso un sistema di classificazione indipendente rispetto alla rete di ricerca tradizionale. L’infrastruttura valuta preventivamente gli interessi degli utenti per suggerire articoli non ricercati attivamente. Le modifiche algoritmiche dedicate parte della Ricerca Google introducono filtri rigorosi sulla provenienza delle notizie e sulla specializzazione dei contenuti.

Filtro di Località e Misurazione della Competenza Tematica

I sistemi di raccomandazione implementano un controllo geografico per determinare la visibilità dei contenuti. Il motore di calcolo verifica la sovrapposizione esatta tra la sede operativa dell’editore e la geolocalizzazione del lettore. Questo meccanismo di blocco limita l’esposizione delle testate internazionali che mirano a intercettare il pubblico di altre nazioni.

L’algoritmo frammenta la misurazione dell’autorevolezza assegnando punteggi separati per singola tematica. Il sistema premia le piattaforme digitali che garantiscono una copertura verticale e continuativa su argomenti specifici. I grandi portali di intrattenimento registrano flessioni di traffico se tentano di posizionarsi su nicchie isolate tramite articoli occasionali.

I criteri di qualità svalutano inoltre le tecniche di scrittura basate sull’occultamento delle informazioni chiave nei titoli. L’uso di toni sensazionalistici progettati unicamente per forzare il clic dell’utente provoca una rapida svalutazione organica all’interno del feed predittivo.

Storico degli aggiornamenti algoritmici di Google tra il 2025 e il 2026

Di seguito, i Google Core Updates che hanno agito sull’intero sistema di valutazione e gli Spam Updates mirati a colpire e declassare le piattaforme che violano apertamente le linee guida ufficiali, rilasciati dal motore di ricerca nel 2025 e nel 2026.

Gli Interventi Strutturali Rilasciati nel 2025

Google nel 2025 ha rilasciato quattro aggiornamenti:

-

L’Aggiornamento di marzo 2025 (Core Update)

L’aggiornamento Core Update di marzo 2025 ha provocato le fluttuazioni più intense dell’anno su tutti i comparti informativi, dal commercio elettronico fino ai portali governativi. Il sistema ha ricalcolato il peso dei forum di discussione, premiando unicamente le grandi community consolidate (come Reddit) e penalizzando drasticamente i portali minori. Gli algoritmi hanno inoltre colpito i domini basati sulla generazione automatica di enormi volumi di pagine prive di reale utilità per le persone;

-

L’Aggiornamento di giugno 2025 (Core Update)

La modifica estiva del Core Update di giugno 2025 ha favorito una maggiore varietà di risorse valide e ha permesso il parziale recupero dei siti precedentemente colpiti dai filtri sulla qualità testuale. L’infrastruttura ha integrato tecnologie avanzate (come i modelli MUVERA e Graph Foundation Model) per mappare l’autorevolezza ed escludere in partenza i documenti irrilevanti. Le reti neurali hanno valutato l’affidabilità basandosi su uno storico dati a lungo termine, rendendo inefficaci le finte manipolazioni causate da attacchi esterni;

-

Il Filtro Antispam di agosto 2025 (Spam Update)

Lo Spam Update di agosto 2025 ha interessato simultaneamente tutte le lingue per potenziare le difese automatiche contro i contenuti ingannevoli. L’intervento ha applicato esclusivamente azioni punitive dirette, senza provocare alcun riposizionamento verso l’alto per i siti virtuosi. L’algoritmo si è limitato a declassare o rimuovere fisicamente dall’indice le pagine in netto contrasto con le norme operative;

-

L’Aggiornamento di dicembre 2025 (Core Update)

L’ultimo intervento dell’anno rappresentato dal Core Update di Dicembre 2025 ha premiato la competenza verticale, sfavorendo le testate generaliste sulle ricerche commerciali mirate (come le classifiche dei prodotti migliori). Queste grandi piattaforme editoriali hanno subito forti oscillazioni anche nei canali dedicati alle notizie, cedendo la visibilità ai marchi ufficiali e ai negozi elettronici specializzati. I siti capaci di dimostrare un vero servizio clienti, recensioni basate sull’esperienza diretta e materiali multimediali privi di banali parafrasi hanno ottenuto i massimi benefici.

L’aggiornamento dedicato a Google Discover nel febbraio 2026

Nel 2026 Google Discover ha ricevuto per la prima volta un intervento strutturale totalmente dedicato:

-

L’Aggiornamento Discover di febbraio 2026

Il Google Discover Update di Febbraio 2026 ha introdotto la prima modifica algoritmica circoscritta al feed di notizie personalizzato, partendo inizialmente dal mercato statunitense in lingua inglese.

Il filtro ha bloccato gli articoli redatti con toni esagerati (clickbait), imponendo l’aggiornamento delle direttive ufficiali per garantire una migliore esperienza di navigazione sulla pagina. La visibilità organica si è ristretta verso un numero minore di editori locali focalizzati su approfondimenti originali, favorendo parallelamente i messaggi istituzionali diffusi tramite i profili sociali certificati.

Il filtro antispam di marzo 2026

Nel marzo 2026 Google ha dato il via al primo aggiornamento antispam dell’anno, caratterizzato per la sua inedita rapidità di esecuzione:

-

L’Aggiornamento antispam di marzo 2026

Il March Spam Update 2026 è stato il primo aggiornamento antispam di Google dell’anno e si è distinto per la sua eccezionale rapidità. Durato appena 19 ore e 30 minuti, ha segnato il record assoluto di velocità per questo tipo di interventi. L’aggiornamento è stato applicato a livello globale e ha coinvolto tutte le lingue.

Si è trattato di un intervento standard di manutenzione ordinaria, senza l’introduzione di nuove policy. Nonostante non vi siano stati comunicati ufficiali di Mountain View, i bersagli principali sembrano essere stati Immagini artificiali di massa, siti di liste fotocopia e SEO programmatica di bassa qualità.

March 2026 Core Update: il primo aggiornamento Core dell’anno

-

L’Aggiornamento di marzo 2026 (Core Update)

Il March 2026 Core Update è stato il primo aggiornamento generale dei sistemi di ranking Google dell’anno, iniziato il 27 marzo e concluso l’8 aprile 2026, per una durata di circa 12 giorni.

Si è trattato di un aggiornamento globale che ha causato una notevole volatilità nelle classifiche, ma senza introdurre nuove regole o linee guida specifiche. In questi casi di norma gli aggiornamenti mirano a migliorare i risultati di ricerca per far emergere in modo più efficace contenuti pertinenti e soddisfacenti per gli utenti, provenienti da qualsiasi tipologia di sito.

In assenza di specifici comunicati da parte di Mountain View, come in questo caso, sono valide le indicazioni generali di Google per rimanere competitivi nel ranking, come l’importanza di concentrarsi sulla creazione di contenuti affidabili, utili e pensati per le persone (“people-first“). I cali di posizionamento non indicano necessariamente degli errori tecnici da correggere sul sito e in ogni caso il recupero avviene di norma con futuri aggiornamenti e non con interventi immediati sui siti.