Punti chiave

Google Discover modifica l’esperienza di ricerca online trasformandola in una ricezione predittiva delle informazioni. Il sistema analizza le abitudini di lettura degli utenti e consente loro di indicare all’algoritmo fonti prioritarie per proporre in automatico un feed di contenuti pertinenti, anticipando le necessità informative.

-

Sintesi e approfondimento tramite intelligenza artificiale

Le funzioni conversazionali dell’IA generativa permettono di andare oltre la lettura dei contenuti generando riassunti e consentendo analisi e approfondimenti;

-

Ottimizzazione per i motori generativi

per essere intercettati dall’algoritmo di Discover, gli editori devono organizzare i dati in modo rigoroso, fornendo testi chiari e facilmente estraibili dai sistemi automatizzati;

-

Qualità tecnica e coerenza editoriale

La visibilità stabile nel feed richiede siti con alte performance tecniche e che non utilizzino pratiche ingannevoli nei titoli e nelle anteprime al solo scopo di attrarre engagement;

-

Transazioni dirette nel feed

Protocolli standard, strumenti e partnership di Google, consentono agli utenti di completare gli acquisti all’interno della schermata di lettura di Discover senza alcun passaggio intermedio verso siti web esterni.

Introduzione a Google Discover: definizione, scopo ed evoluzione storica

Google Discover rappresenta una componente centrale dell’ecosistema informativo offerto dal motore di ricerca di Mountain View. Questo strumento propone una ricezione passiva e predittiva delle informazioni, prima ancora che l’utente formuli una query esplicita.

Cos’è Google Discover e qual è il suo scopo principale

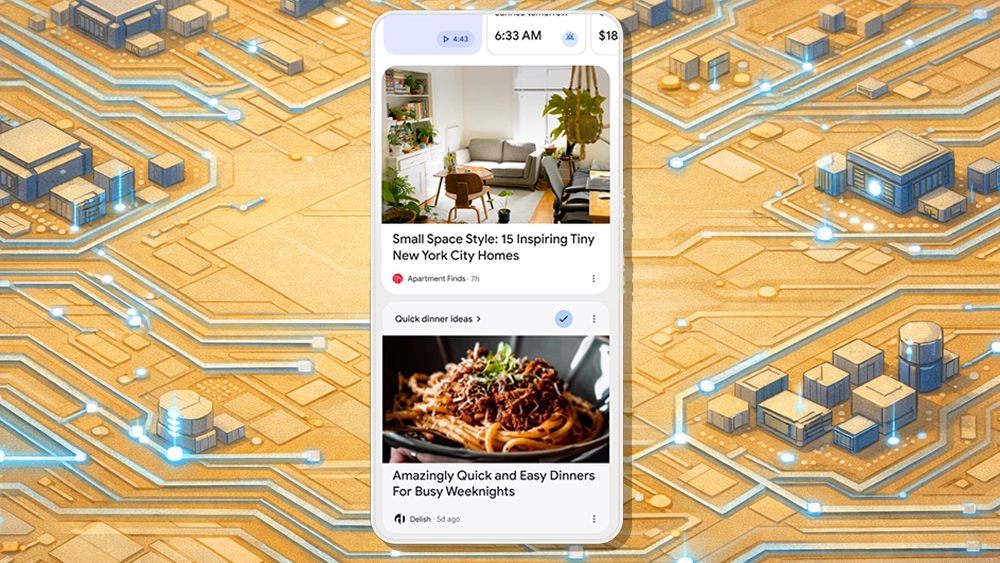

Google Discover è un feed di contenuti automatizzato e iper-personalizzato, integrato principalmente nell’applicazione Google per dispositivi mobili e nella schermata iniziale dei browser su smartphone. Il suo scopo consiste nell’anticipare i bisogni informativi dell’utente.

Il sistema offre articoli, video e notizie basati sullo storico delle ricerche e sulle interazioni passate. Questo meccanismo crea un flusso continuo di aggiornamenti su misura per ogni singolo individuo.

Discover opera in background, elaborando costantemente i segnali di interesse per mantenere il feed sempre aggiornato e pertinente. In questo modo, la scoperta di nuove informazioni avviene in maniera fluida e del tutto automatizzata. L’utente riceve stimoli visivi e testuali allineati ai propri interessi.

Evoluzione storica da Google Feed a Discover

L’infrastruttura attuale affonda le sue radici in Google Feed, un prodotto lanciato inizialmente per fornire aggiornamenti base fondati sulle preferenze esplicite. Con il successivo rebranding e il potenziamento tecnologico, il sistema ha assunto il nome di Discover.

L’evoluzione ha introdotto algoritmi molto più sofisticati per la comprensione profonda del contesto e delle abitudini di lettura quotidiane.

Il rinnovamento da Feed a Discover ha apportato inoltre un’enfasi maggiore sull’aspetto visivo dell’interfaccia. Sono state introdotte immagini di anteprima ad alta risoluzione e formati multimediali decisamente più coinvolgenti.

Questa trasformazione ha reso la piattaforma un aggregatore dinamico di contenuti. Il risultato finale garantisce una rilevanza tematica superiore e una fruizione immediata per il lettore.

Differenze fondamentali tra Google Search e Google Discover

La distinzione architetturale tra Google Search e Google Discover si basa interamente sulla natura dell’intento dell’utente.

Google Search opera secondo una logica di acquisizione attiva dell’informazione. In questo scenario tradizionale, l’individuo manifesta un bisogno esplicito digitando una parola chiave e il sistema restituisce le risposte più pertinenti.

Al contrario, Google Discover funziona con una logica di distribuzione proattiva e predittiva. Il feed spinge automaticamente i contenuti verso lo schermo basandosi su calcoli probabilistici e preferenze anziché su richieste testuali. Questa divergenza metodologica modifica profondamente le metriche di valutazione e di ingaggio.

La ricerca classica premia la rispondenza esatta a una query ben strutturata e stabile nel tempo. Discover, invece, intercetta interessi latenti e affinità tematiche implicite.

Funzionamento dell’algoritmo di raccomandazione e criteri di ranking

L’algoritmo di raccomandazione alla base del feed valuta in modo continuativo la qualità e la pertinenza dei contenuti. L’infrastruttura di ranking opera su vettori di qualità indipendenti, analizzando le abitudini dell’utente e l’autorevolezza della fonte.

Il framework valutativo si consolida attraverso l’allineamento tra l’intento latente del lettore, la prossimità dell’informazione e la profondità tecnica del documento proposto.

Il ruolo del machine learning e del knowledge graph

Il sistema di raccomandazione si appoggia su architetture avanzate di apprendimento automatico (machine learning) per mappare gli interessi dell’utente. Il motore analizza lo storico delle interazioni e le query passate per costruire un profilo di preferenze altamente dettagliato.

Questa profilazione viene incrociata con il Knowledge Graph (il database semantico di Google che collega entità, persone e concetti). L’integrazione tra i modelli di apprendimento e la rete semantica permette all’algoritmo di comprendere le relazioni profonde tra gli argomenti.

In questo modo, l’infrastruttura riesce a proporre contenuti logicamente correlati ancor prima che si manifesti un bisogno esplicito. La comprensione semantica garantisce che le raccomandazioni seguano filoni tematici coerenti con le letture precedenti.

Segnali di ranking, personalizzazione e Locality Filter

La visibilità dei contenuti proposti si basa su segnali espliciti progettati per massimizzare la contestualizzazione. Uno degli elementi determinanti in questo senso è la rilevanza geografica, identificata tecnicamente dall’algoritmo noto come Locality Filter e introdotta nel febbraio 2026 con il primo Google Core Update dedicato esclusivamente a Discover, a dimostrazione dell’importanza che questa funzionalità ha assunto per la società di Mountain View.

Il sistema privilegia i contenuti prodotti da editori radicati nella medesima area geografica degli utenti. L’obiettivo è ancorare l’informazione al contesto socioculturale e normativo locale.

Sul fronte dell’esperienza di navigazione, le performance dei siti degli editori si saldano organicamente con il livello contenutistico. I parametri essenziali per la permanenza nel feed includono:

-

Ottimizzazione del caricamento

Il sistema analizza i tempi di risposta del server e la velocità di rendering dell’elemento visivo principale, con particolare enfasi sul caricamento istantaneo delle immagini in evidenza;

-

Usabilità sui dispositivi mobili

L’algoritmo verifica la perfetta adattabilità dell’interfaccia alle differenti risoluzioni degli schermi, controllando l’adeguatezza dei target tattili e la fluidità della leggibilità nativa del testo;

-

Stabilità visiva e navigazione

La valutazione algoritmica premia le pagine prive di spostamenti improvvisi del layout durante il caricamento e penalizza la presenza di ostacoli che bloccano la fruizione come gli interstitial;

-

Qualità della sessione

Il motore monitora i tassi di rimbalzo e il fenomeno del pogo-sticking (il rapido ritorno dell’utente al feed dopo il clic), utilizzandoli come indicatori primari di insoddisfazione o scarsa pertinenza.

Impatto dei principi E-E-A-T e dell’autorità topica verticale

La misurazione del framework E-E-A-T (Esperienza, Competenza, Autorevolezza, Affidabilità) definito nelle Linee Guida di Google e che il motore di ricerca utilizza per valutare la qualità dei contenuti, avviene in modo granulare: il sistema valuta l’autorità di un dominio procedendo argomento per argomento, calcolando l’affidabilità in modo frammentato.

L’infrastruttura di Discover premia la profondità di copertura e la consistenza editoriale rispetto all’estensione. Il presupposto è che una piattaforma iper-specializzata possiede un’autorità topica superiore rispetto a un portale generalista che affronta lo stesso tema in modo occasionale o isolato.

La densità della competenza verticale viene interpretata dal motore come il segnale primario di affidabilità. L’applicazione di questi criteri innalza le soglie di accesso per le informazioni a potenziale impatto critico, riducendo drasticamente la visibilità dei portali privi di verifiche autoriali stringenti.

La convergenza tra Google Discover e l’Intelligenza Artificiale Generativa

Il perimetro operativo di Discover si può espandere oltre il semplice elenco di contenuti grazie all’integrazione dell’intelligenza artificiale, realizzando scenari in cui i contenuti non sono una destinazione finale, ma un punto di partenza per una sessione esplorativa. L’ambiente si trasforma in un ecosistema interattivo capace di elaborare richieste complesse direttamente sulle schede informative proposte.

L’integrazione dei modelli LLM e dei sommari IA nel feed

Il catalizzatore di questo cambiamento strutturale è il modello multimodale Gemini (capace di elaborare testi, immagini e audio). Il modello IA di Google innalza radicalmente le capacità di ragionamento e di sintesi dell’intera infrastruttura di raccomandazione.

Il sistema generativo crea risposte automatizzate direttamente all’interno delle interfacce di esplorazione, generando sommari relativi a determinati argomenti.

Funzionalità interattive: l’esplorazione contestuale tramite AI Mode

L’interazione tra il feed e le tecnologie generative si concretizza inoltre attraverso l’abilitazione di funzioni conversazionali accessibili dai singoli articoli. Quando l’utente seleziona una scheda informativa, l’interfaccia mette a disposizione la modalità di risposta generativa AI Mode come livello interattivo all’interno di Discover.

Questo menu contestuale permette di invocare agenti virtuali per eseguire operazioni cognitive sul testo in tempo reale. Le interazioni a disposizione del lettore possono essere per esempio:

-

Sintesi automatica

La generazione istantanea di un riassunto dei punti chiave dell’articolo facilita l’assimilazione rapida dei testi più lunghi e complessi tramite la funzione Summarize con AI Mode;

-

Domande di approfondimento

L’abilitazione di un prompt conversazionale permette all’utente di porre interrogativi specifici relativi esclusivamente al perimetro semantico del contenuto appena esplorato;

-

Esplorazione laterale

Un’azione di ricerca ampliata istruisce il motore generativo a fornire background storici e definizioni tecniche non esplicitamente trattate nell’articolo sorgente, avviando la funzione Dive deeper con AI Mode.

L’impatto sulle dinamiche di traffico e le query zero-click

L’introduzione di queste funzionalità genera per gli editori conseguenze profonde su andamento e qualità del traffico web che premia chi è capace di offrire esperienze dirette di prima mano.

Al polo opposto, i portali orientati alla produzione di contenuti utilitaristici basati su aggregazioni di dati pubblici subiscono severe contrazioni di traffico.

Questa flessione deriva dalla capacità delle intelligenze artificiali di esaudire completamente il fabbisogno informativo all’interno dell’interfaccia, innescando il fenomeno delle query zero-click.

Di conseguenza, si azzera l’incentivo a visitare il sito sorgente per le informazioni a rapido consumo come previsioni meteo, oroscopi, risultati sportivi e altri contenuti molto popolari che in precedenza garantivano ai publisher visite e conseguenti introiti pubblicitari.

Requisiti tecnici, UX e linee guida editoriali

Come già accennato, l’infrastruttura di Google Discover premia anche l’efficienza tecnica. Il posizionamento all’interno del feed richiede dunque una sinergia perfetta tra contenuti affidabili e un’esperienza di navigazione fluida.

Norme relative ai contenuti e idoneità per l’inclusione

La buona posizione nel feed dipende dal rispetto di precise norme qualitative e dall’assenza di pratiche ingannevoli. Ciò è particolarmente valido per i settori sensibili come la salute, la finanza e il benessere.

I portali attivi in questi ambiti privi di verifiche autoriali stringenti subiscono contrazioni significative di visibilità.

Al contrario, le piattaforme che dimostrano un’autorità topica verticale e un approccio giornalistico rigoroso consolidano la loro presenza. La competenza specifica diviene il prerequisito fondamentale per superare i filtri di idoneità.

Importanza delle performance e del design dei siti

La qualità editoriale si salda organicamente con le performance dei siti. I Core Web Vitals (le metriche standardizzate da Google per misurare l’esperienza utente e le prestazioni dei siti) rappresentano coefficienti fondamentali per stabilizzare la permanenza dei contenuti nel feed di Discover.

La valutazione tecnica si articola su differenti direttrici:

-

Ottimizzazione del caricamento

Il sistema valuta i tempi di risposta del server e l’efficienza visiva, ponendo un’enfasi assoluta sulla velocità di rendering dell’immagine in evidenza. L’integrazione di immagini ad alta definizione all’interno di un’architettura rapida contribuiscono ad aumentare la visibilità;

-

Usabilità sui dispositivi mobili

L’algoritmo verifica l’adattabilità dell’interfaccia agli schermi degli smartphone. Il motore controlla le dimensioni dei target tattili e garantisce una leggibilità nativa del testo totalmente priva di frizioni;

-

Stabilità e struttura visiva

La piattaforma premia le pagine web prive di spostamenti improvvisi del layout durante la navigazione. Parallelamente, penalizza la presenza di ostacoli visivi (come popup invadenti) che bloccano la fruizione immediata;

-

Qualità della sessione post-clic

Il motore monitora attentamente il comportamento del lettore dopo l’accesso all’articolo. Il sistema utilizza i tassi di abbandono e il pogo-sticking (il rapido ritorno dell’utente al feed iniziale) come indicatori di scarsa pertinenza o bassa qualità.

Congruenza semantica: la penalizzazione del curiosity gap

La coerenza dell’informazione richiede un allineamento tra il titolo dell’articolo e il corpo del testo. I classificatori algoritmici analizzano la congruenza tra gli elementi di sintesi e di anteprima con i contenuti.

Il sistema diminuisce la priorità di contenuti che implementano il curiosity gap, una pratica manipolatoria che consiste nell’omettere deliberatamente informazioni chiave nel titolo per forzare l’utente a cliccare.

L’algoritmo penalizza inoltre l’utilizzo di costrutti sensazionalistici o di esagerazioni che non trovano un supporto reale nei fatti narrati. La piattaforma abbandona le logiche di ranking basate sui semplici tassi di clic per abbracciare parametri orientati al reale soddisfacimento del bisogno informativo.

Formati di fruizione e integrazione multimodale

L’evoluzione tecnologica si traduce in una profonda trasformazione visiva dell’interfaccia utente. L’ambiente digitale diventa un aggregatore multimodale che assume caratteristiche di interattività tipiche dei social network.

Questa architettura espande le modalità di fidelizzazione, affiancando formati eterogenei progettati per assecondare diverse soglie di attenzione del lettore. Il feed perde la rigidità del classico elenco di notizie.

La funzionalità Follow e la costruzione di community dedicate

La presenza di un pulsante di iscrizione alle fonti rende attiva la dinamica della piattaforma Discover, fornendo uno strumento concreto per una curatela proattiva delle informazioni desiderate.

Gli utenti possono iscriversi direttamente ai profili degli editori tramite la funzionalità Follow, in modo da ottenere un flusso cronologico di contenuti afferenti esclusivamente alle fonti preferite.

L’abilitazione di questo canale per gli editori richiede la corretta configurazione di feed RSS o Atom all’interno del codice sorgente del sito web ospitante, senza cui l’inclusione nella scheda dedicata risulta impossibile.

Questo meccanismo converte i segnali qualitativi in relazioni stabili, mitigando la volatilità tipica della distribuzione organica. La costruzione dell’autorevolezza si riflette nella capacità concreta di generare una base di iscritti solida.

L’inclusione di contenuti social, caroselli visivi e video verticali

Discover include elementi che vanno oltre il contenuto testuale. L’interfaccia affianca infatti agli articoli giornalistici tradizionali nuovi flussi multimediali interattivi.

L’espansione abbraccia formati diversificati per massimizzare il tempo di permanenza, tra cui:

-

Aggiornamenti in tempo reale

Il sistema integra i flussi informativi testuali e i dibattiti provenienti dalle principali piattaforme di microblogging;

-

Caroselli fotografici e video brevi

Vengono proposte sequenze di immagini a scorrimento e video ottimizzati per la fruizione rapida sui differenti schermi;

-

Interazioni tramite Web Intents

Sfruttando specifiche librerie di programmazione gli editori hanno la possibilità di stimolare la condivisione dei contenuti su piattaforme social.

L’ottimizzazione strategica per Discover: Search Engine Optimization (SEO) e Generative Engine Optimization (GEO)

Discover impone l’adozione di metodologie operative inedite per i creatori di contenuti. Le strategie editoriali si distaccano dalla pura ricerca dei volumi associati alle singole parole chiave per abbracciare un approccio semantico profondamente strutturato.

Bilanciamento tra contenuti evergreen e iper-specializzazione di nicchia

Come già sottolineato i dati sui flussi di visite documentano il netto successo dei publisher di nicchia e delle piattaforme focalizzate sulla costruzione di autorità verticale. Il sistema concentra la distribuzione del traffico verso un gruppo più ristretto di editori riconosciuti come massimamente autorevoli all’interno dei rispettivi silos tematici.

Per mantenere una visibilità stabile, risulta essenziale bilanciare la produzione di articoli sempreverdi con una profonda specializzazione tematica. L’approfondimento verticale dimostra competenza e presidia in modo saldo il proprio settore di riferimento.

I principi della Generative Engine Optimization per l’editoria digitale

Il panorama tecnico per gli specialisti dell’ottimizzazione comprende la Generative Engine Optimization (GEO). Questa recente disciplina, che si può considerare una verticalità della più generale Search Engine Optimization (SEO) con cui è probabilmente destinata a fondersi nel medio periodo, adatta le strategie di visibilità alle logiche di sintesi tipiche delle intelligenze artificiali, superando le vecchie metriche basate esclusivamente sui clic.

L’obiettivo primario dell’editore consiste nell’essere citato come riferimento diretto degli algoritmi di inteligenza artificiale durante il processo di elaborazione delle risposte generative. Il sito web deve dunque fornire materiale testuale inequivocabile e facilmente estraibile dai modelli linguistici.

Questa pratica permette di capitalizzare sulla visibilità indiretta, garantendo l’attribuzione della fonte anche quando il clic tradizionale viene assorbito dall’agente conversazionale. La struttura del testo favorisce la lettura automatizzata rispetto a formati puramente creativi.

Implementazione avanzata dei dati strutturati e metadati

Per essere selezionato dall’algoritmo predittivo e integrato nelle sintesi automatizzate, il contenuto deve presentare un’architettura dei dati assolutamente ineccepibile. La precisione tecnica diviene un requisito di base per l’indicizzazione avanzata.

Le ottimizzazioni fondamentali richiedono un intervento profondo sul codice della pagina, che deve agire su elementi precisi:

-

Dati strutturati per le entità

L’utilizzo di marcatori Schema.org per le entità definisce in modo esatto i concetti trattati, eliminando le ambiguità semantiche per il motore di analisi;

-

Strutturazione degli attributi

L’organizzazione logica e categorizzata delle specifiche tecniche e dei dati fattuali facilita il recupero granulare delle informazioni da parte dei classificatori;

-

Profili autore trasparenti

La creazione di pagine dedicate agli scrittori, referenziate e ricche di dettagli professionali, certifica la responsabilità editoriale e rafforza i segnali di affidabilità e competenza.

Ecosistema normativo e nuove frontiere di monetizzazione

Le funzionalità come Google Discover, che si basano in parte su dati e preferenze degli utenti si confrontano con un panorama normativo europeo sempre più esigente. Le direttive sulla concorrenza e sulla tutela delle informazioni personali ridefiniscono strutturalmente l’operatività delle piattaforme digitali.

Tale contesto stimola l’ingegnerizzazione di soluzioni inedite per mantenere la sostenibilità economica attraverso una profonda riprogettazione per adattarsi ai nuovi vincoli di tracciamento e di elaborazione dei dati.

Implicazioni del Digital Markets Act e privacy nello User Choice

Il quadro legislativo impone regole precise per prevenire posizioni dominanti nella scoperta dei contenuti sui dispositivi. L’attenzione istituzionale si concentra sulle dinamiche di accesso alle tecnologie e sulla gestione autonoma dell’identità digitale.

Le piattaforme devono adeguarsi a specifici obblighi legali che influenzano in modo diretto la distribuzione delle informazioni. Le direttive principali impattano tre aree fondamentali:

-

Interoperabilità dei sistemi operativi

Le normative richiedono che i fornitori di intelligenze artificiali esterne godano di privilegi di accesso alle funzionalità dei dispositivi analoghi a quelli riservati ai servizi nativi. Questa direttiva promuove la completa apertura dei sistemi mobili per garantire un mercato equo;

-

Condivisione dei dati di ricerca

I motori di ricerca devono concedere ai concorrenti l’accesso a set di informazioni anonimizzate relative alle metriche di visualizzazione. La condivisione delle metriche di ranking risulta vitale per consentire l’addestramento di modelli linguistici alternativi;

-

Gestione granulare del tracciamento

Il tracciamento comportamentale ha abbandonato la deprecazione forzata dei cookie di terze parti per adottare un’architettura basata sulla scelta esplicita dell’utente. Il sistema delega al singolo individuo il controllo puntuale sulle preferenze di condivisione dei propri dati.

In caso di negazione del consenso, gli inserzionisti devono fare affidamento su modelli probabilistici e sulle interfacce di programmazione (API) crittografate. Di conseguenza, le informazioni acquisite direttamente dagli editori diventano essenziali per strutturare campagne pubblicitarie mirate.

L’architettura dell’Agentic Commerce e le transazioni native

L’evoluzione delle interfacce automatizzate sposta il commercio digitale verso gli acquisti delegati all’IA (noti tecnicamente come Agentic Commerce). Le transazioni economiche vengono effettuate integralmente all’interno delle applicazioni di scoperta, senza passaggi intermedi.

Questo approccio elimina la necessità di reindirizzare il consumatore verso portali esterni. L’ecosistema si basa su protocolli tecnologici specifici progettati per chiudere il ciclo di acquisto in un unico ambiente:

-

Gestione nativa del carrello

Il protocollo di commercio universale abilita il checkout direttamente all’interno delle interfacce automatizzate, mantenendo intatto il controllo dei venditori sulla relazione con il cliente;

-

Esecuzione crittografica dei movimenti

L’infrastruttura si affida a sistemi di pagamento sicuri per elaborare le transazioni finanziarie. Le operazioni vengono gestite tramite le piattaforme partner o i portafogli digitali integrati nei dispositivi;

-

Iniezione di promozioni dinamiche

Il sistema introduce offerte dirette e sconti esclusivi nel momento esatto della conversazione con l’agente virtuale. Questa dinamica riduce drasticamente l’incidenza delle tradizionali reti di affiliazione e dei portali di coupon esterni.

La convergenza di queste tecnologie condensa l’intero percorso decisionale del cliente. La promozione, la selezione della merce e il pagamento finale si fondono in un’esperienza d’acquisto completamente fluida.

Monitoraggio delle performance e analisi dei dati

Il controllo dei risultati all’interno dell’ecosistema Discover richiede un’osservazione costante delle metriche di interazione. L’analisi dei dati permette agli editori di comprendere l’impatto reale dei propri contenuti.

Questa supervisione tecnica risulta fondamentale per ottimizzare le strategie editoriali e mantenere una visibilità stabile nel tempo.

Utilizzo del rapporto Discover in Google Search Console

Il monitoraggio tecnico si affida a strumenti come Google Search Console (GSC) che tracciano le performance degli articoli. La piattaforma fornisce pannelli di controllo specifici che registrano fedelmente le metriche di visualizzazione e di clic generate all’interno del feed.

Gli editori analizzano i dati per comprendere il comportamento del pubblico. Queste informazioni sono essenziali per strutturare i contenuti e ottimizzarli per gli algoritmi di Discover.

Analisi delle fluttuazioni di traffico e della stagionalità

La natura proattiva del feed genera fisiologiche variazioni nei volumi di visite quotidiane. Il tracciamento documenta una continua ricalibrazione delle gerarchie di visibilità tra i vari portali.

Le fluttuazioni del traffico dipendono direttamente da tre fattori operativi:

-

Comportamento post-clic

Il motore osserva attentamente la qualità della sessione, analizzando i tassi di rimbalzo e la permanenza sulla pagina dopo l’accesso all’articolo;

-

Prossimità territoriale

L’algoritmo distribuisce le visite privilegiando la presenza di segnali sul territorio e la vicinanza geografica tra la sede dell’editore e il lettore;

-

Soddisfacimento in interfaccia

La capacità dei sistemi automatizzati di esaudire le richieste direttamente nella schermata iniziale genera contrazioni di traffico per i contenuti di natura generica.

Questi indicatori confermano che la stabilità delle visite richiede un allineamento costante con gli interessi latenti del pubblico.