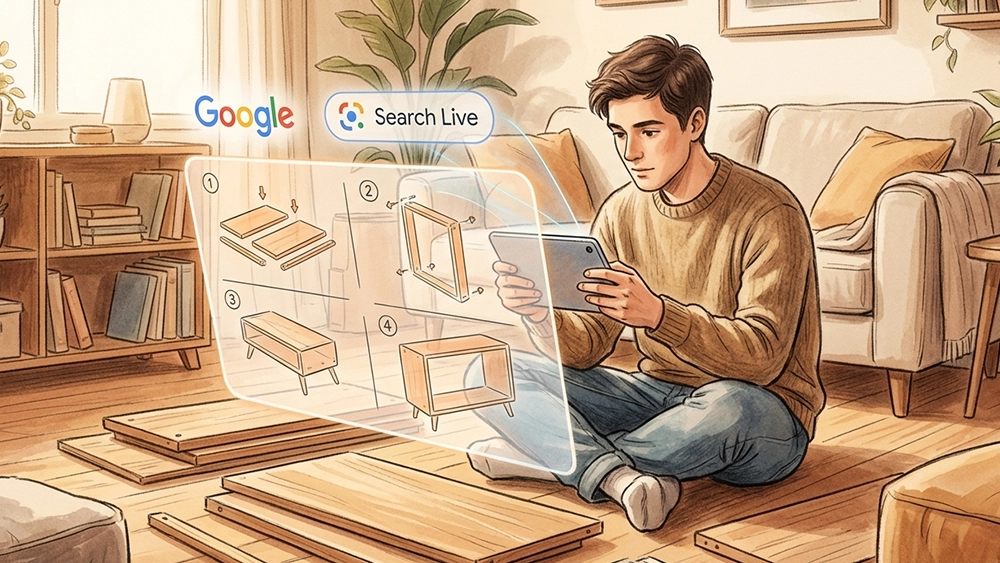

Google ha annunciato l’arrivo di Search Live in oltre 200 paesi e territori, aprendo le porte della multimodalità anche agli utenti in Italia. Il sistema permette di interagire con le informazioni in modo conversazionale, utilizzando la voce o inquadrando oggetti con lo smartphone per ricevere risposte immediate.

La ricerca in tempo reale debutta su Android e iPhone

L’aggiornamento trasforma il telefono in un assistente capace di interpretare ciò che osserva e sente attraverso l’app Google per Android e iOS. Toccando l’icona “Live” posizionata sotto la barra di ricerca, gli utenti possono avviare una conversazione parlata o attivare la fotocamera per aggiungere contesto visivo alle loro domande.

La funzione, integrata stabilmente in AI Mode, garantisce anche l’accesso a link web e risorse esterne per approfondire argomenti emersi durante la sessione multimodale.

Il motore Gemini 3.1 Flash Live abbatte le barriere linguistiche

Alla base del sistema c’è il modello Gemini 3.1 Flash Live progettato per eliminare i ritardi nelle risposte e rendere il parlato più naturale. Essendo nativamente multilingue, riconosce la lingua preferita dell’utente senza bisogno di modificare manualmente le impostazioni.

Questa architettura tecnica permette alla Ricerca Google di gestire flussi video e audio in simultanea, rendendo l’esplorazione del web simile a una normale conversazione.

Il test negli USA e l’espansione globale di Search Live

L’approdo globale di oggi è il culmine di un percorso di test iniziato nel 2025. Search Live ha mosso i primi passi limitatamente ai mercati di Stati Uniti e India. La fase sperimentale ha permesso di affinare la capacità dell’intelligenza artificiale di comprendere non solo le parole, ma anche il contesto fisico inquadrato dalle lenti degli smartphone.

Informazione contro produttività: la distinzione tra Search Live e Gemini Live

Nella strategia di sviluppo della società è fondamentale distinguere Search Live dall’assistente personale Gemini Live. Mentre l’assistente puro si focalizza sulla gestione dei compiti quotidiani e della produttività individuale, Search Live intende rimanere ancorato alla mission storica del gruppo di Mountain View: “organizzare le informazioni a livello mondiale e renderle universalmente accessibili e utili”.

La differenza sostanziale risiede nell’output, poiché il sistema di ricerca comprende sempre un ponte diretto verso il web aperto, fornendo link e risorse esterne per approfondire e verificare ogni risposta, scenario con cui si confronta la Search Engine Optimization (SEO) e che rappresenta una sfida per gli editori, poiché seppure i contenuti web siano citati è inevitabile che l’approdo sui medesimi in molte occasioni non sia più indispensabile. E se ciò accade in contesti testuali generativi come quello delle AI Overviews, la situazione è anche più dinamica e complessa con la multimodalità insita in Search Live.

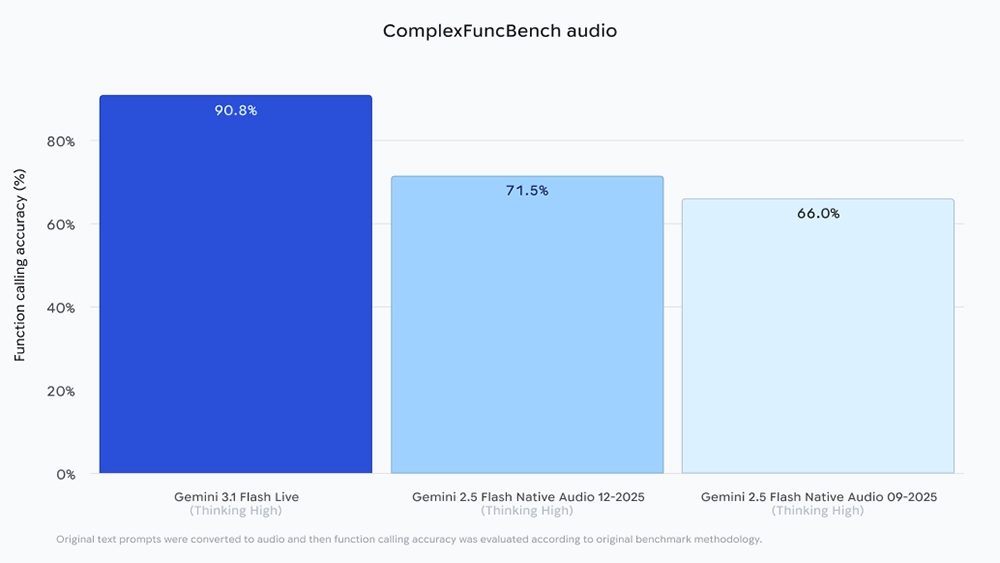

La roadmap tecnologica: il passaggio alla nuova architettura Flash

Il motore che alimenta Search Live ha subito un’accelerazione decisa negli ultimi mesi. Dopo l’introduzione dei modelli Gemini 2.5 Flash Native Audio avvenuta nel dicembre 2025, l’architettura si è evoluta adesso con la versione 3.1 Flash Live.

Questo passaggio è una variazione strutturale che permette di gestire flussi di dati molto più complessi con una latenza ridotta, rendendo l’interazione fluida e priva delle pause tipiche delle tecnologie precedenti.

Tecnologia e visione: come cambia l’esperienza di ricerca

L’architettura dietro questa evoluzione è pensata per rendere il dialogo con la macchina immediato e privo di ostacoli tecnici. Il servizio “è nato per supportare gli utenti in tempo reale quando digitare una domanda risulterebbe troppo lento o complesso”, spiega sul blog dell’azienda Liza Ma, responsabile del prodotto Search in Google.

Gemini 3.1 Flash Live: velocità e memoria raddoppiata

Gemini 3.1 Flash Live è ottimizzato per ridurre al minimo i tempi di attesa tra domanda e risposta: il modello ha raggiunto un punteggio del 90,8% nel benchmark ComplexFuncBench Audio. Un dato fondamentale riguarda la coerenza delle sessioni, con una capacità di ricordare i dettagli della conversazione due volte superiore rispetto alle versioni precedenti.

Search Live in Google Lens: la ricerca che osserva il mondo

L’accesso alle funzioni multimodali è immediato: come già accennato basta un tocco sull’icona “Live” all’interno dell’app Google per avviare il dialogo, mentre se l’utente desidera chiedere informazioni su un oggetto fisico può attivare la fotocamera per fornire un contesto visivo istantaneo.

La funzione è accessibile anche mentre si utilizza Google Lens, permettendo di trasformare ciò che si vede nell’obiettivo dei dispositivi in una conversazione bidirezionale. Questa integrazione tra voce e visione permette alla ricerca di offrire suggerimenti contestuali precisi.

Sicurezza e nuove frontiere: l’impatto di Search Live sull’ecosistema digitale

L’integrazione di sistemi così avanzati porta con sé nuove sfide per la trasparenza e la tutela dei contenuti. Per questo, ogni flusso audio generato da Gemini 3.1 Flash Live include il watermarking SynthID. Si tratta di un marcatore digitale che permette di identificare i contenuti prodotti dall’intelligenza artificiale, garantendo la tracciabilità delle risposte.

La ricerca multimodale apre agli sviluppatori con le nuove API

L’espansione non riguarda solo gli utenti finali, ma apre nuove opportunità per chi crea software e servizi digitali. Google ha reso disponibile in anteprima la Gemini Live API all’interno di Google AI Studio. Questo permette agli sviluppatori di integrare le capacità di conversazione naturale nelle proprie applicazioni.

Live Translate debutta su iPhone anche in Italia

Insieme alla ricerca, crescono gli strumenti dedicati alla comunicazione globale. La funzione Live Translate di Google Traduttore sbarca ufficialmente su iOS, portando la traduzione simultanea in cuffia su iPhone. Il servizio si espande in mercati chiave come Italia, Germania e Giappone.